Crawl Budget چیست و چگونه آن را بهینه کنیم؟

در دنیای رقابتی وب امروز، داشتن یک وبسایت با محتوای ارزشمند کافی نیست؛ بلکه باید اطمینان حاصل کنید که گوگل صفحات شما را بهسرعت و بهطور مؤثر خزش و ایندکس میکند. اینجاست که مفهوم بودجه خزش (Crawl Budget) اهمیت پیدا میکند. مدیریت درست Crawl Budget میتواند سرعت دیده شدن صفحات مهم شما را افزایش داده و از هدررفت منابع گوگل جلوگیری کند. با رعایت اصول بهینهسازی و ابزارهای مناسب، میتوانید عملکرد سایت خود را در نتایج جستجو بهبود دهید. برای دریافت مشاوره تخصصی، میتوانید به خدمات سئو در اصفهان مراجعه کنید.

آنچه در این مقاله میخوانید ...

Crawl Budget چیست؟

بودجه خزش یا Crawl Budget به تعداد صفحاتی گفته میشود که رباتهای گوگل (Googlebot) در یک بازه زمانی مشخص میتوانند در سایت شما خزش و بررسی کنند. این پارامتر نشان میدهد که گوگل چه مقدار منابع و زمان را برای کشف، بررسی و ایندکس صفحات سایت شما اختصاص میدهد. هرچه Crawl Budget بیشتر باشد، صفحات سایت سریعتر توسط گوگل خزش و ایندکس میشوند و تغییرات جدید یا صفحات تازه اضافه شده سریعتر در نتایج جستجو ظاهر میشوند.

اهمیت Crawl Budget در سئو سایت

Crawl Budget اهمیت زیادی در سئو سایت دارد، زیرا تعیین میکند که صفحات کلیدی سایت شما با چه سرعتی در گوگل دیده شوند. اگر بودجه خزش پایین باشد، حتی محتوای باکیفیت شما ممکن است دیر ایندکس شود و در نتایج جستجو تأخیر پیدا کند. برای سایتهای بزرگ یا سایتهایی که محتوایشان بهطور مرتب بهروزرسانی میشود، مدیریت صحیح Crawl Budget میتواند به افزایش سرعت ایندکس صفحات، بهبود رتبهبندی و افزایش ترافیک ارگانیک کمک کند.

چه وبسایتهایی باید به Crawl Budget اهمیت دهند؟

بهطور کلی، وبسایتهایی که حجم بالایی از صفحات دارند یا محتواهایشان بهطور مداوم تغییر میکند، باید به بودجه خزش توجه ویژهای داشته باشند. سایتهای فروشگاهی بزرگ، پلتفرمهای خبری یا سایتهایی با بیش از صدها هزار صفحه، نمونههایی هستند که اگر Crawl Budget آنها بهینه نباشد، صفحات مهم دیرتر ایندکس میشوند. همچنین، سایتهایی که پیام «Discovered – currently not indexed» در Google Search Console دریافت میکنند، نشان میدهد که رباتها صفحات آنها را کشف کردهاند اما هنوز ایندکس نشدهاند و نیازمند مدیریت بودجه خزش هستند.

نحوه عملکرد Crawl Budget و Googlebot

نقش Googlebot در خزیدن سایت

Googlebot ربات رسمی گوگل است که مسئول خزش (Crawling) صفحات وب و جمعآوری اطلاعات آنها برای ایندکس کردن است. این ربات بهصورت سیستماتیک صفحات سایت را بررسی میکند و دادههای مرتبط با محتوا، لینکها و ساختار سایت را جمعآوری میکند. Googlebot تعیین میکند که کدام صفحات ارزش بیشتری برای ایندکس شدن دارند و بر اساس این اولویتبندی، از بودجه خزش سایت استفاده میکند.

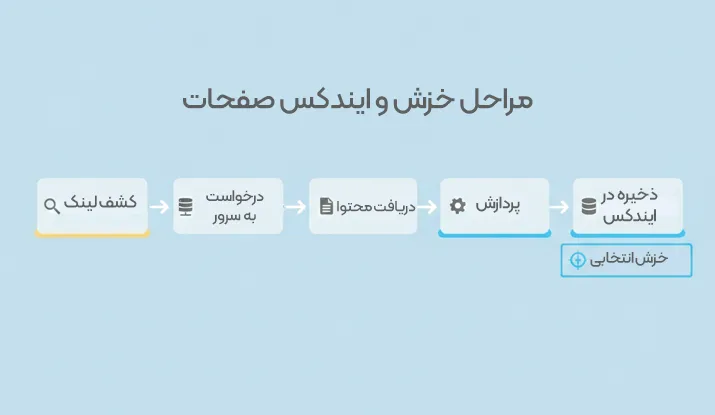

مراحل خزش و ایندکس صفحات

فرآیند خزش شامل چند مرحله اصلی است: ابتدا URLهای جدید یا تغییر یافته کشف میشوند، سپس Googlebot بررسی میکند که آیا این صفحات مجاز به خزش هستند یا خیر. در مرحله بعد، محتوا، کدهای HTML و لینکهای صفحه تحلیل میشوند تا موضوع و اهمیت آن تعیین شود. پس از این مرحله، اطلاعات صفحه در پایگاه داده گوگل ذخیره شده و برای رتبهبندی صفحات استفاده میشود. در نهایت، Googlebot صف بعدی URLها را بررسی میکند و این چرخه برای تمامی صفحات سایت ادامه مییابد.

Crawl Limit و Crawl Demand چیست؟

Crawl Limit یا محدودیت خزش نشان میدهد که سرور شما چه تعداد درخواست همزمان را میتواند تحمل کند بدون آن که دچار اختلال شود. در مقابل، Crawl Demand یا نیاز به خزش، ارزش و اهمیت هر صفحه را برای ایندکس شدن تعیین میکند. هرچه صفحات شما مهمتر، تازهتر و با لینکهای داخلی و خارجی بیشتری حمایت شوند، نیاز به خزش آنها بالاتر است و Googlebot منابع بیشتری را برای بررسی آنها اختصاص میدهد.

Crawl Budget و تاثیر آن بر ایندکس صفحات سایت

ارتباط Crawl Budget با نحوه ایندکس صفحات در گوگل

بودجه خزش تعیین میکند که Googlebot چه تعداد صفحات سایت شما را در یک بازه زمانی مشخص بررسی کند. هر چه بودجه خزش بالاتر باشد، صفحات تازه یا بهروزرسانیشده سریعتر ایندکس میشوند و محتوا شما زودتر در نتایج جستجو نمایش داده میشود. به عبارت دیگر، Crawl Budget بهطور مستقیم سرعت ایندکس شدن و در نهایت رتبهبندی صفحات شما را تحت تأثیر قرار میدهد.

صفحاتی که اولویت خزش دارند

Googlebot صفحات سایت را بر اساس چند فاکتور اولویتبندی میکند. صفحات با محتوای تازه، محبوب یا دارای لینک داخلی و خارجی با کیفیت، بالاترین اولویت را دارند. همچنین صفحات مهم سایت مانند صفحه اصلی، صفحات دستهبندی و لندینگهای کلیدی معمولاً زودتر از صفحات کماهمیت و تکراری خزیده میشوند.

سناریوهای هدررفت Crawl Budget

هدررفت بودجه خزش زمانی رخ میدهد که Googlebot منابع خود را صرف صفحاتی کند که ارزش ایندکس ندارند یا تکراری هستند. این موارد میتواند شامل ریدایرکتهای طولانی، صفحات یتیم یا URLهای با پارامترهای غیرضروری باشد. هدررفت Crawl Budget باعث میشود صفحات مهم دیرتر خزش شوند و در نتیجه سرعت ایندکس و رتبهبندی سایت کاهش یابد.

بهینهسازی Crawl Budget سایت

روشهای ساده برای افزایش بهرهوری بودجه خزیدن

حذف ریدایرکتهای اضافه

وجود ریدایرکتهای متعدد مسیر Googlebot را طولانی میکند و باعث هدررفت بودجه خزشی میشود. برای مثال، اگر صفحهای به صورت زنجیرهای به چند صفحه دیگر منتقل شده باشد، ربات مجبور است مسیر طولانی را طی کند. بهترین کار این است که زنجیرهها را کوتاه کرده و صفحات را مستقیماً به مقصد نهایی ریدایرکت کنید.

بهینهسازی صفحات یتیم و پارامترهای URL

صفحات یتیم، صفحاتی هستند که هیچ لینک داخلی به آنها داده نشده و Googlebot برای پیدا کردن آنها زمان بیشتری صرف میکند. همچنین پارامترهای غیرضروری در URL میتوانند باعث تکراری دیده شدن صفحات شوند. با لینکسازی داخلی مناسب و مدیریت پارامترها، میتوانید بودجه خزشی را صرف صفحات مهمتر کنید.

مسدودسازی صفحات غیرضروری در Robots.txt

صفحات مدیریتی، فیلترهای محصول یا صفحاتی که ارزش ایندکس ندارند را میتوان با فایل Robots.txt از خزش Googlebot خارج کرد. این کار باعث میشود بودجه خزش برای صفحات کلیدی سایت صرف شود و سرعت ایندکس شدن آنها افزایش یابد.

Technical SEO پیشرفته برای مدیریت بهتر Googlebot

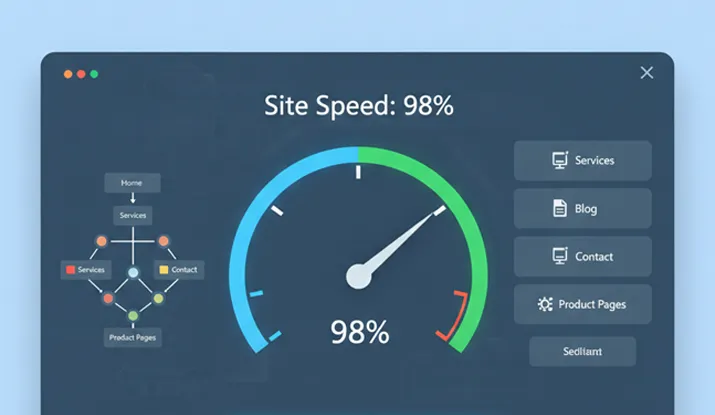

بهبود سرعت سایت و سرور

سرورهایی با پاسخدهی سریع، امکان خزش تعداد بیشتری از صفحات را به Googlebot میدهند. بهینهسازی سرور، استفاده از CDN، فشردهسازی محتوا و فعالسازی کش، از روشهای مؤثر برای افزایش نرخ خزیدن هستند. برای یادگیری روشهای عملی، به مقالهی افزایش سرعت سایت در ۷ مرحله مراجعه کنید.

ساختار وبسایت و لینکسازی داخلی

یک ساختار وبسایت منظم و خوشهای (Pillar-Cluster) باعث میشود رباتها سریعتر صفحات مرتبط را کشف کنند. لینکهای داخلی استراتژیک مسیر خزش رباتها را کوتاه کرده و اهمیت صفحات کلیدی را به Googlebot منتقل میکنند.

استفاده از دادههای ساختاریافته و متادیتا

استفاده از Structured Data و متادیتا به رباتها کمک میکند محتوای صفحات را بهتر درک کنند. این کار باعث میشود صفحات مهم سریعتر ایندکس شوند و در نتایج جستجو بهدرستی نمایش داده شوند.

استفاده از یک چکلیست کامل Technical SEO به شما کمک میکند تا ساختار سایت و لینکهای داخلی را بهینه کنید و Crawl Budget را به شکل مؤثرتری مدیریت کنید.

بررسی و گزارش Crawl Budget با ابزارها

Google Search Console

در بخش Crawl Stats گوگل سرچ کنسول میتوانید تعداد صفحات خزیده شده، میانگین سرعت پاسخ سرور و میزان داده دانلود شده توسط رباتها را مشاهده کنید. این آمار به شما کمک میکند عملکرد Crawl Budget را بررسی و نقاط ضعف سایت را شناسایی کنید.

SEMrush و Ahrefs

ابزارهای SEMrush و Ahrefs امکان بررسی دقیق صفحات کرالشده، شناسایی ریدایرکتها، صفحات یتیم و فرصتهای لینکسازی داخلی را فراهم میکنند. گزارشات این ابزارها برای برنامهریزی بهینهسازی Crawl Budget بسیار مفید هستند.

جمعبندی

بودجه خزش یا Crawl Budget تعیین میکند که رباتهای گوگل چه تعداد و کدام صفحات سایت شما را در یک بازه زمانی مشخص خزش میکنند و مدیریت صحیح آن برای بهبود ایندکس صفحات مهم حیاتی است. با حذف ریدایرکتهای غیرضروری، بهینهسازی صفحات یتیم، مدیریت پارامترهای URL و مسدودسازی صفحات کمارزش در Robots.txt میتوان از هدررفت بودجه خزشی جلوگیری کرد.

همچنین بهبود سرعت سرور، استفاده از ساختار منظم سایت و لینکسازی داخلی هدفمند، همراه با بهکارگیری دادههای ساختاریافته و متادیتا، باعث میشود Googlebot صفحات اصلی را سریعتر پیدا و ایندکس کند. بررسی منظم Crawl Stats از طریق ابزارهایی مانند Google Search Console، SEMrush و Ahrefs به شناسایی مشکلات خزش و ارزیابی اثر بهینهسازیها کمک میکند. در مجموع، تمرکز روی این اقدامات تضمین میکند بودجه خزشی به شکل بهینه صرف صفحات با ارزش شود و شانس حضور صفحات مهم در نتایج جستجو افزایش یابد.

مونا داوری

سلام! من مونا داوری هستم، عاشق تولید محتوا و دنیای سئو. هدفم اینه که با کلمات، تجربهای مفید و جذاب برای شما بسازم و به سایتها کمک کنم دیده بشن.